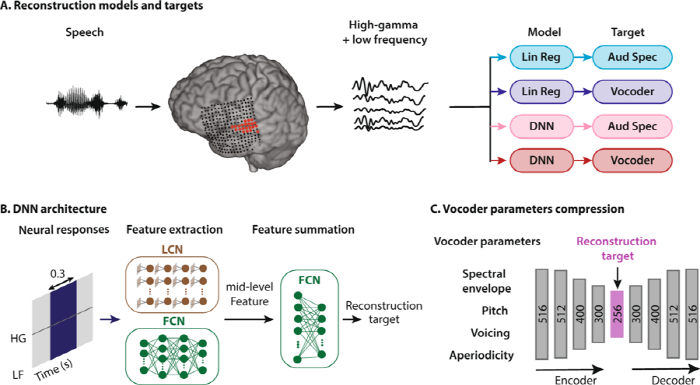

| ММАшРћРЮ АњЧаРњГЮ 'ГзРЬУГ(Nature)'ДТ 29РЯ(ЧіСі НУАЂ) РЬААРК ПЌБИ АсАњИІ РкИХСі ЛчРЬО№ЦМЧШ ИЎЦїЦЎ(Scientific Reports)ПЁ 'Towards reconstructing intelligible speech from the human auditory cortex'РЬЖѓДТ ГэЙЎИэРИЗЮ АдРчЧпДй. ФУЗГКёОЦ ДыЧа ДЯИЖ ИоНКАЁЖѓДЯ(Nima Mesgarani) БГМі ПЌБИЦРРЬ АГЙпЧб РЬ НУНКХлРК BCI(Brain–Computer Interface)РЧ УжСО ИёРћСі РдБИПЁ Чб Йп Дѕ СјРдЧб АЭРИЗЮ ЦђАЁЕЧАэ РжДй. Ся НУНКХлРЛ РЬПыЧи ИЛЧЯСі ОЪОЦЕЕ ГњРЧ НХШЃИІ РаАэ ЙЋОљРЛ Л§АЂЧЯАэ ИЛЧЯЗСАэ ЧЯДТСіИІ ОЫ Мі РжДйДТ РЧЙЬДй. BCI БтМњРК Л§АЂИИРИЗЮ ГњЦФИІ МОМЗЮ РќДоЧи ФФЧЛХЭГЊ БтАшИІ ПђСїРЬДТ БтМњРЛ ИЛЧбДй. ГњЦФПЁМ ЛчЖїРЧ ИЛРЛ Л§МКЧв Мі РжДТ РЬ НУНКХлРК РНМК ЧеМК РхФЁПЭ РЮАјСіДЩРЛ ШАПыЧи ФФЧЛХЭАЁ ГњПЭ СїСЂ ХыНХЧв Мі РжДТ ЛѕЗЮПю ЙцЙ§РЛ ИИЕч БтМњРЬДй. ЦЏШї СіБнБюСі РќЧє ЛчЗЪАЁ ОјДТ МіСиРЬЖѓ ЦђАЁЙоАэ РжДй. НКЦМКь ШЃХЗ ЙкЛчЕЕ ОЮДј РќНХ БйРАРЬ ММШї ИЖКёЕЧДТ РЯИэ ЗчАдИЏКДРЮ БйРЇУрМКУјЛіАцШСѕ(ALS) ШЏРк, ГњСЙСпПЁМ ШИКЙЧб ЛчЖї Ею ГњРЧ БтДЩРК ЧЯАэ РжСіИИ ИЛРЛ РпЧв Мі ОјДТ ЛчЖїРЬ РЬ НУНКХлРЛ РЬПыЧЯИщ РЧЛчМвХы ДЩЗТРЛ ЕЧУЃРЛ Мі РжДй.  Ёу РНМК РчБИМК ЙцЙ§ МГИэ БзИВ [ЛчРЬО№ЦМЧШ ИЎЦїЦЎ(Scientific Reports)] Ёу РНМК РчБИМК ЙцЙ§ МГИэ БзИВ [ЛчРЬО№ЦМЧШ ИЎЦїЦЎ(Scientific Reports)]

ИоНКАЁЖѓДЯ БГМіДТ "ПьИЎРЧ ИёМвИЎДТ СжРЇРЧ ФЃБИГЊ АЁСЗ Йз Рќ ММАш ЛчЖїЕщАњ ПЌАсЧЯДТ ИХПь РЏПыЧб АЭРИЗЮ, КЮЛѓРЬГЊ СњКДРИЗЮ РЮЧи ИёМвИЎИІ ГО Мі ОјДТ ЛчЖїЕЕ ДйНУ ДыШЧв Мі РжАд ЕШДйДТ РЧЙЬДй"Аэ ИЛЧпДй. СіГ МіНЪ ГтАЃРЧ ПЌБИПЁМ РЮАЃРЬ ИЛРЛ Чв ЖЇГЊ ЙКАЁИІ Л§АЂЧв ЖЇ РЮАЃРЧ ЕЮГњДТ ЖбЗЧЧб ШАЕП ЦаХЯРЬ ГЊХИГЊДТ АЭРИЗЮ ЙрЧєСіАэ РжДй. ЖЧЧб ЙнДыЗЮ ДЉБКАЁРЧ ИЛРЛ ЕщРЛ ЖЇ, ШЄРК ЕшДТ АЭРЛ ЛѓЛѓЧв ЖЇПЁЕЕ ГњАЁ РЮНФ АЁДЩЧб НХШЃ ЦаХЯРЬ ГЊХИГДй. РЬЗЏЧб ЦаХЯРЛ БтЗЯЧЯАэ Бз ГЛПыРЛ ЧиЕЖЧЯДТ ПЌБИДТ СіБнБюСіЕЕ РЬЗчОюСЎ ПдДй. ИоНКАЁЖѓДЯ БГМіЕЕ ГњРЧ НХШЃПЁМ ИЛЧЯАэРк ЧЯДТ ГЛПыРЛ ЧиЕЖЧЯДТ ПЌБИИІ ЧиПТ РЮЙАРЬДй. РЬ КаОпРЧ УЪБт ПЌБИДТ ГњРЧ УЛАЂ ЧЧСњПЁМ БтЗЯЕШ НХШЃИІ КаМЎЧЯАэ ДыШ ГЛПыРЛ РчБИМКЧЯЗСДТ ФФЧЛХЭ И№ЕЈРЛ ИИЕщОњДй. ЧЯСіИИ РЬ ЙцЙ§РК РЬЧиЧЯБт НЌПю ДыШ РНМКРЛ Л§МКЧЯДТ АЭРЬ АяЖѕЧпБт ЖЇЙЎПЁ ИоНКАЁЖѓДЯ БГМі ПЌБИЦРРК ДйИЅ БтМњПЁ ЕЕРќЧпДй. Бз ЙцЙ§РК РЮАЃРЧ ДыШИІ РЬПыЧи ШЦЗУЧб ФФЧЛХЭ ОЫАэИЎСђ НХШЃПЁМ ДыШ ГЛПыРЛ КаМЎЧЯАэ ЧеМКЧв Мі РжДТ КИФкДѕ ОЫАэИЎСђРЛ РЬПыЧб АЭРЬДй. ИоНКАЁЖѓДЯ БГМіРЧ МГИэПЁ ЕћИЃИщ ОЦИЖСИ ПЁФк(Echo)ПЭ ОжЧУ НУИЎ(Siri)АЁ СњЙЎПЁ РНМКРИЗЮ РРДфЧЯБт РЇЧи ЛчПыЧЯДТ БтМњАњ ЕПРЯЧб АЭРЬДй. ИоНКАЁЖѓДЯ БГМі ПЌБИЦРРК КИФкДѕ ГњРЧ ШАЕП ЦаХЯРЛ АЁИЃФЁБт РЇЧи БзЗЙРЬЦЎГи НХАцАњЧа ПЌБИМв(Neuroscience Institute at Great Neck)ПЁМ РЯЧЯДТ НХАцПмАњ РЧЛч ОЦНЌ Е№ГзНЌ ИоХИ(Ashesh Dinesh Mehta) ЙкЛчПЭ ЦРРЛ РЬЗя ПЌБИЧЯАэ АјЕПРИЗЮ ГэЙЎРЛ НшДй. ИоХИ ЙкЛчДТ БзАЃ ГњРќСѕ ШЏРкИІ ФЁЗсЧиПТ РЮЙАЗЮ РЯКЮ ШЏРкДТ МіМњЗЮ ФЁЗсЧЯАэ РжДй. ПЌБИЦРРК РЬЙЬ ГњМіМњРЛ ЙоРК ГњРќСѕ ШЏРкРЧ Гњ ПоТЪ ЙнБИПЁ АэЙаЕЕРЧ АцИЗ ЧЯКЮ БзИЎЕх РќБиРЛ РЬНФЧи ДыШИІ ЕщЗССжИщМ Гњ ШАЕП ЦаХЯРЛ УјСЄЧЯДТ СЖЛчИІ НЧНУЧпДй. РЬЖЇ БтЗЯЕШ Гњ ШАЕП ЦаХЯРЛ КИФкДѕПЁ ЧаНРНУФзДй. РЬОю ПЌБИЦРРК ААРК ШЏРкПЁАд 0ПЁМ 9 ЛчРЬРЧ М§РкИІ ИЛЧЯДТ МвИЎИІ ЕшАэ Гњ ШАЕПРЧ ЦаХЯРЛ КИФкДѕПЁ РдЗТЧпДй. РЬШФ КИФкДѕДТ 0ПЁМ 9БюСіРЧ М§РкИІ ММДТ МвИЎИІ ЕщРЛ ЖЇ ЙпЛ§ЧЯДТ Гњ ШАЕПРЧ ЦаХЯПЁМ РкНХРЧ ЧеМК РНМКРЛ УтЗТЧЯДТ ЕЅ МКАјЧпДй. РЬ РНМКРЛ РЮАјСіДЩРЮ НХАцИСРИЗЮ КаМЎЧЯАэ ЛчЖїРЬ ЕщРЛ Мі РжДТ МіСиРИЗЮ УГИЎЧб АЭРЬДй. ДйРН ИЕХЉ(https://zuckermaninstitute.columbia.edu/sites/default/files/m5_dnn_vocoder.mp3)ИІ ХЌИЏЧЯИщ НУНКХлРЬ ГњРЧ ШАЕП ЦаХЯРЛ КаМЎЧи Л§МКЧб РНМКРЛ ЕщРЛ Мі РжДй. НЧСІ ЕщОюКИИщ СЖБн Рп ОЫОЦЕшБт ОюЗСПю КЮКаЕЕ РжСіИИ, ПЕОюЗЮ 0ПЁМ 9БюСіРЧ М§РкИІ ГЖЕЖЧЯАэ РжДй. НЧЧш АсАњ, НУНКХлРЬ ГњЦФПЁМ ДыШ ГЛПыРЛ Л§МКЧв Мі РжДТ ШЎЗќРК 75%ПДДй. РЬДТ ИоНКАЁЖѓДЯ БГМіРЧ РЬРќ ПЌБИ АсАњПЭ КёБГЧиМ ОіУЛГ ТїРЬАЁ ГДй. ИоНКАЁЖѓДЯ БГМіДТ "ЙЮАЈЧб КИФкДѕПЭ АЗТЧб НХАцИСРЧ СЖЧеРИЗЮ ГюЖѓПю СЄШЎЕЕЗЮ МвИЎИІ Л§МКЧв Мі РжОњДй"Аэ ИЛЧпДй. ОеРИЗЮ ПЌБИЦРРК Дѕ КЙРтЧб ДмОюГЊ ЙЎРхРЛ ХзНКЦЎЧв АшШЙРЬДй. ЖЧЧб ПЌБИЦРРК УжСО ИёЧЅЗЮ ШЏРкАЁ РкНХРЧ Л§АЂРЛ СїСЂ ИЛЗЮ КЏШЏЧЯБт РЇЧб РгЧУЖѕЦЎ БтМњ АГЙпРЛ АшШЙ СпРЬДй. ИоНКАЁЖѓДЯ БГМіДТ "РЬ НУНКХлРК АдРг УМРЮРњАЁ ЕЩ АЭ"РЬЖѓИч "КЮЛѓРЬЕч СњКДРЬЕч, ИЛЧЯБт ДЩЗТРЛ РвРК ЛчЖїПЁАд ДйНУ СжКЏ ММАшПЭ ПЌАсЧЯДТ ЛѕЗЮПю БтШИИІ СІАјЧв АЭ"РЬЖѓАэ ИЛЧпДй. |